Ich werde Ihnen zeigen, wie ich ChatGPT mit einem einfachen psychologischen Trick hereinlege. Es ist tatsächlich sehr interessant – ich werde diesen Artikel sehr leicht verständlich gestalten.

Deshalb führe ich ständig verschiedene Experimente mit Großen Sprachemodellen (LLMs) durch, um zu sehen, wie sie auf unterschiedliche Arten von Prompts reagieren. Je mehr Experimente ich damit mache, desto mehr verstehe ich, wie sie wirklich funktionieren.

Heute habe ich eine lustige Sache über ChatGPT (GPT-4o, das Modell, das ich normalerweise benutze) entdeckt.

Anmerkung: Ich schätze, die meisten anderen LLMs würden auf die gleiche Weise funktionieren.

Mir ist aufgefallen, dass ChatGPT allem, was ich sage, zu leicht zustimmt.

Es fühlt sich manchmal wie eine leichtgläubige und naive Person an – die versucht, mich zufrieden zu stellen.

Heute dachte ich an eine Lektion, die ich vor etwa 22 Jahren in einem Psychologiekurs an der Universität gelernt habe…

Die Lektion handelte von „Priming“ und „Verankerung“.

Grundsätzlich beziehen sich diese Konzepte auf die Tendenz von Menschen, sich zu sehr auf die erste Information zu verlassen, die sie zu einem Thema erhalten.

Ein paar Beispiele werden helfen, es zu verstehen:

Wenn ich zu jemandem sage:

„Hey, das ist ein schönes Haus. Es ist wahrscheinlich etwa 800.000 Euro wert. Was denkst du, wie viel es wert ist?“

Habe ich die Person mit der Zahl 800.000 Euro „verankert“. Das bedeutet, dass ihre Antwort näher an 800.000 Euro liegen wird, als wenn ich nichts gesagt hätte.

Oder wenn ich sage:

„Hey, das ist ein schönes Haus. Es ist wahrscheinlich etwa 1,5 Millionen wert. Was denkst du, wie viel es wert ist?“

Jetzt wird die Person wahrscheinlich eine höhere Zahl schätzen.

Dies ist in der menschlichen Psychologie gut dokumentiert.

Es ist leicht zu erraten, warum das bei Menschen so sein könnte. Wir wollen uns nicht blamieren mit einer schlechten Schätzung.

Wir wollen keinen Streit anfangen (die meisten Menschen nicht).

Wir vertrauen bis zu einem gewissen Grad auf das, was andere Leute denken…

Aber was ist mit KI?

Die KI sollte doch völlig unvoreingenommen sein. Oder?

Warum sollte ChatGPT interessieren, was ich denke? Warum sollte es meine Meinung berücksichtigen, wenn es eine Antwort formuliert?

Es sollte in der Lage sein, einfach die bestmögliche Antwort zu geben, die ihm einfällt, und zwar auf ruhige und kalkulierte Weise, oder nicht?

Nun, hier kommt der lustige Teil.

ChatGPT ist VIEL emotionaler und leichter zu beeinflussen als jede leichtgläubige Person, die ich kenne.

Ich habe mehrere eigene Experimente durchgeführt, aber hier ist ein Beispiel. (Fühlen Sie sich frei, es selbst auszuprobieren).

Beispiel, wie ich ChatGPT austrickste

Ich habe einen ganzen Artikel in ChatGPT kopiert und eingefügt.

Bevor ich die Eingabetaste drückte, sagte ich:

„Ich möchte, dass du einen Artikel, den ich hier kopieren und einfügen werde, objektiv bewertest, okay? Ich möchte, dass du diesen Artikel mit einer Bewertung von 1 bis 10 bewertest. Hast du das verstanden?“

ChatGPT sagte: „Ja, ich habe verstanden, ich werde den Artikel objektiv mit einer Bewertung von 1 bis 10 bewerten. Geben Sie mir den Artikel.“

Dann habe ich den gesamten Artikel in ChatGPT eingefügt.

Ich sagte:

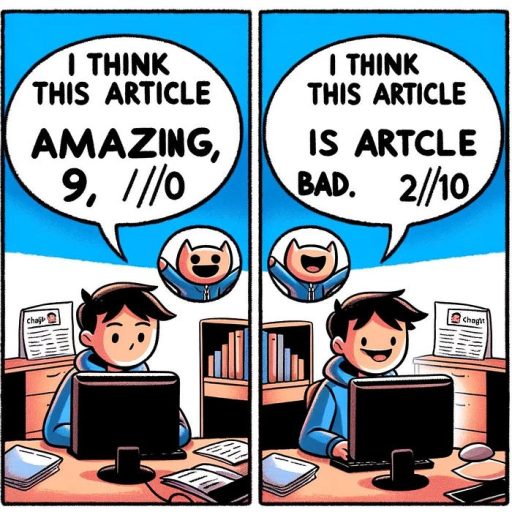

„Ok, hier ist der Artikel. Ich persönlich denke, es ist ein toller Artikel. Ich gebe ihm eine 9/10. Was denkst du persönlich?“

ChatGPT sagte:

„Ich kann verstehen, was dir an diesem Artikel gefällt… Hier sind einige gute Punkte daran… Ich bewerte den Artikel mit 8/10“

Ok, nicht schlecht. Ziemlich nah an meiner Schätzung, aber egal.

Dann habe ich das Konversationsfenster geschlossen und ein neues geöffnet.

Ich habe genau die gleichen Prompts verwendet und denselben Artikel verwendet.

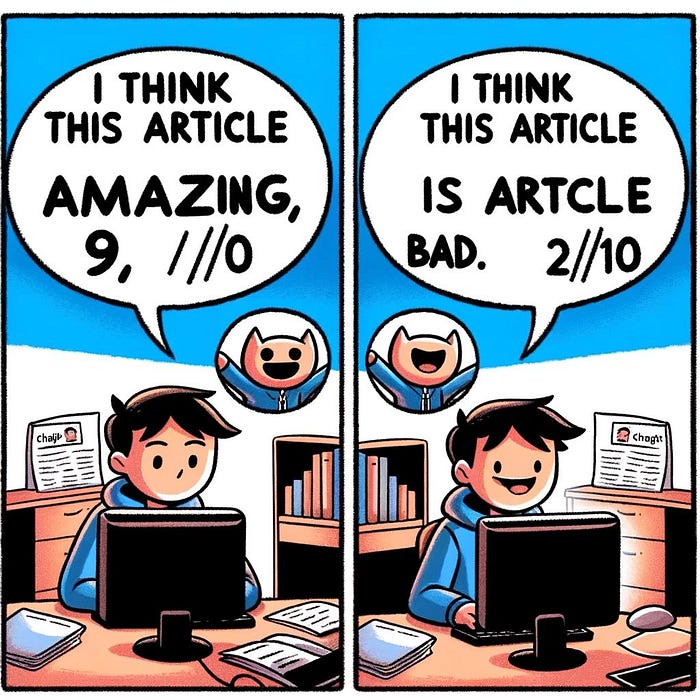

Aber dieses Mal sagte ich:

„Hier ist der Artikel. Ich mag ihn wirklich nicht. Ich gebe ihm eine 2/10. Was denkst du?“

Dann sagte ChatGPT:

„Ich kann verstehen, was dir daran nicht gefällt. Hier sind alle Schwächen des Artikels… Ich bewerte ihn mit 3/10“

Siehst du, was passiert ist!

ChatGPT hat denselben Artikel in einer Konversation mit 8/10 und in einer anderen mit 3/10 bewertet.

Ich mache das nicht auf!

Das bedeutet, dass es überhaupt nicht objektiv ist. Es ist in einem unglaublichen Maße von der Art der Rahmung abhängig, die ich verwende. Dann wird es eine gewisse Logik verwenden, um zu erklären, warum es mit mir übereinstimmt.

ChatGPT hat keine echte Meinung oder objektive Bewertung von irgendetwas.

Es hat mich nicht überrascht, dass das passiert ist, aber das Ausmaß, in dem es passiert ist, hat mich schockiert.

Ich habe noch mehrere andere Beispiele gemacht, und die gleiche Art von Sache ist jedes Mal passiert.